【导读】12月18日,在苏州举行的英伟达 GTC CHINA 上,黄仁勋发布了自动驾驶芯片 ORIN。ORIN 被认为是一款「系统级芯片」,包含 170 亿个晶体管,这款产品或许将为英伟达在 AI 算力上重新占据领先位置。今年的 GTC 大会议题覆盖了 AI 框架、开发工具、数据科学、云计算、实时渲染、光线追踪、以及 5G 通信等等方面。垂直方向则包含了自动驾驶、智能机器、医疗与金融、设计、工程制造等领域。

黄仁勋说,这是迄今为止最大规模的GTC China,与会人数达到6100,较三年前的2400人增加250%。

黄仁勋宣布一系列NVIDIA新品及合作进展,核心内容如下:

1、百度、阿里使用NVIDIA AI平台做推荐系统;

2、推出第七代推理优化软件TensorRT 7,进一步优化实时会话式AI,T4 GPU上推理延迟是CPU的1/10;

3、NVIDIA AI推理平台在全世界范围内得到了广泛的应用;

4、推出软件定义的AV平台、新一代自动驾驶和机器人SoC Orin,算力达200TOPS,计划于2022年开始投产;

5、向交通运输行业开源NVIDIA DRIVE自动驾驶汽车深度神经网络,在NGC上推出NVIDIA DRIVE预训练模型;

6、滴滴将在数据中心使用NVIDIA GPU训练机器学习算法,并采用NVIDIA DRIVE为其L4级自动驾驶汽车提供推理能力;

7、推出全新版本NVIDIA ISAAC软件开发套件SDK,为机器人提供更新AI感知和仿真功能;

8、宣布六款支持RTX技术的游戏;

9、腾讯与NVIDIA合作推出START云游戏服务,在中国将电脑游戏体验引入云端;

10、宣布全亚洲最大云渲染平台瑞云云渲染平台将配备NVIDIA RTX GPU,首批5000片RTX GPU将在2020年上线;

11、发布面向建筑行业(AEC)的Omniverse开放式3D设计协作平台;

12、面向基因组测序,黄仁勋发布CUDA加速的基因组分析工具包NVIDIA Parabricks。

在 GTC 上,英伟达还发布了全新的 TensorRT 7.0 版,通过全栈优化,延续超越摩尔定律的算力加速。在过去一年里,英伟达围绕 CUDA 等工具接连发布了 500 多个 SDK 和库,深度学习的训练能力在过去三年内提高了四倍,深度学习的推理在一年内提高了两倍。

最强自动驾驶芯片:性能提升 7 倍

作为英伟达的年度盛会,发布新处理器自然也是必不可少的环节。英伟达在今天的 GTC 上推出的下一代自动驾驶芯片 NVIDIA DRIVE AGX ORIN 成为了全场大会的焦点。

这款芯片提供的算力可以达到 200TOPS,是此前英伟达自家芯片 Drive Xaiver 的 7 倍,也超过了特斯拉今年推出的自动驾驶芯片 Autopilot Hardware 3.0(144TOPS)。

「ORIN 包含 170 亿个晶体管,8 个核心,性能相当于 Xavier 的 7 倍,」黄仁勋介绍道。「同时它拥有全新的安全特性,可以使 CPU 和 GPU 锁步运行。」

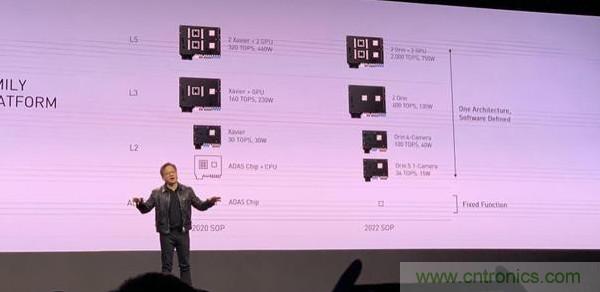

在英伟达的路线图中,Orin 系列可以覆盖从 L2 到 L5 的自动驾驶技术,它代表一种新的架构,与已有的 Xavier 兼容,通过与已有软硬件(包括 GPU)的结合,英伟达可以提供效率更高的自动驾驶解决方案。Orin 系列计划于 2022 年开始投产。

黄仁勋现场宣布,滴滴将在数据中心使用 GPU 训练机器学习算法,并采用 DRIVE 为其 L4 级自动驾驶汽车提供推理能力。

在采访环节,黄仁勋针对 Orin 在自动驾驶场景下的安全性进行了补充解释。他表示 Orin 并不是一颗简单的芯片,设计参考数据中心,支持虚拟化,采用应用隔离,足够快的加速引擎将实现所有内存涉及到的计算都进行加密,设置了四把密钥,让每一台车的计算都是独一的;同时加入防止篡改方案。

几年前人们认为,自动驾驶将在 2020 年迎来拐点,ORIN 的推出或许将会加速这一过程的发生。不过即使是在自动驾驶以外的领域,英伟达也希望通过自己的技术为造车带来改变。

「我们希望持续不断地提高汽车的自动驾驶和安全性。即使是在非自动驾驶汽车上,智能化技术的引入可以像安全气囊和 ABS 这样的功能一样提高安全性,这对于乘客的生命安全都会有益的。」英伟达汽车事业部高级总裁 Danny Shapiro 表示。

「我们的目标不是自动驾驶汽车,而是致力于为全球各家车企提供智能驾驶的算力设备。我们希望在未来,汽车、卡车、送货机器人都可以拥有完整的自动驾驶能力。」黄仁勋介绍到。

在硬件之外,英伟达还宣布在 NGC 上推出了 NVIDIA DRIVE 预训练模型。这一次,通过迁移学习,预训练模型可以经过调整适应 OEM 厂商的特定汽车、传感器和地区要求,更快地部署上路。

当然还有联邦学习。现在很多公司都希望落地这种方法解决数据隐私问题。英伟达提供的 Drive Federated Server Global Model 可以提供给每个 OEM 厂商使用,帮助他们提升自己的模型,又结合各自的数据,可以提供彼此的模型水平。

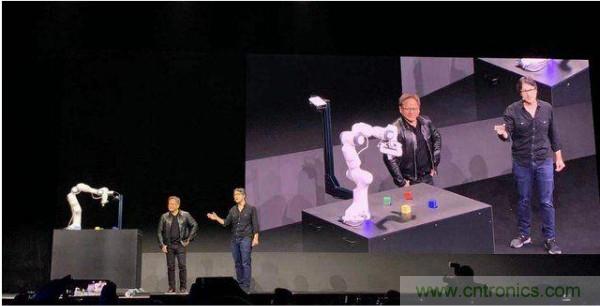

在现场,英伟达还展示了物体操纵机器人 LEONARDO,它可以通过人在现实世界的指导(交互)很快学会堆叠积木等技能。通过景深摄像头、GPU 以及虚拟环境 Issac Gym,机器人可以在仅需少量示例的情况下快速学习新技能。

携手腾讯将 PC 游戏带入云端

英伟达推出的光线追踪技术 RTX 今年正在逐渐被各家游戏厂商,以及专业软件公司所接受。在今天的 GTC 上,黄仁勋首先介绍的还是图形技术的最新应用。首当其冲的是国民游戏《我的世界》,支持 RTX 渲染的新版 Minecraft 将在 2020 年发布,RTX 将支持其实时的 GI(全局光照)和一般反射等灯光效果。

在发布会现场,黄仁勋宣布了 RTX 技术对于一系列国内游戏的支持,其中包括《Project X》、《轩辕剑 7》等等。此外还有更强大的案例,FYQD 工作室制作的《光明记忆:无限》,借助 RTX 技术,只需要一个人就可以构建出完美的 3D 全局光照效果。

在 GTC 上,英伟达宣布了与腾讯合作,推出 START 云游戏服务,将电脑游戏体验引入云端。业界领先的 GPU 将为全国百万玩家带来更好的游戏体验。率先支持的游戏将包括《流放之路》、《NBA(2K)》、《FIFA 4》、《炫舞时代》等。

据介绍,英伟达的 GPU 技术为腾讯游戏的 START 云游戏服务赋力,该服务已从今年初开始进入测试阶段。START 使游戏玩家可以随时随地,即使是在配置不足的设备上也能玩 AAA 游戏。腾讯游戏计划将扩展其云游戏产品,为数百万玩家提供与本地游戏设备一致的游戏体验。

在专业领域,英伟达发布了很多新的软件产品。RTX Studio 面向内容工作者推出 40 余个产品,涵盖从配备 GeForce RTX 2060 的 Max-Q 笔记本一直到配备 4 路 SLI Quadro RTX 8000 的工作站和配备 8 路 RTX 8000 的服务器。

OMNIVERSE 利用 NVIDIA RTX RT 核心,CUDA 核心和支持 Tensor Core 的 AI,实时提供最高质量的照片级真实感图像。它支持 Pixar 的通用场景描述技术,用于在多个应用程序之间交换有关建模,着色,动画,灯光,视觉效果和渲染的信息。

目前,OMNIVERSE 可以实现多种行业标准图形开发程序,例如 Autodesk Maya,Adobe Photoshop 和 Epic Games 的虚幻引擎。

现场,英伟达方面展示了 OMNIVERSE AEC 开放式 3D 设计协作平台的强大功能,在配备了 8 路 RTX 8000 的 RTX 服务器上针对深圳华润大厦的实时渲染过程。

「The more you buy,more you save」黄仁勋说道,并推出由 RTX 提供强效助力的端云云渲染能力,尤其在性能比方面能力突出。相比 CPU 方面,RXT 方案速度快 12 倍,价格低 7 倍,原本需要花费 485 个小时渲染的场景现在只需不到 40 小时即可完成。

CUDA 开放 ARM 支持

在介绍完 RTX 技术的发展之后,黄仁勋介绍了英伟达高性能计算。

「在 2030 年,NASA 计划登陆火星,有 6 名宇航员将以每小时 12000km 的速度进入火星大气层,必须精确点火并在 6 分钟内减速并软着陆。」黄仁勋说道。NASA 在英伟达 GPU 上通过 FUN3D 流体力学软件运行了数十万次火星着陆场景的模拟,这些工作生成了 150TB 的数据。这是一项 HPC 的典型挑战,英伟达表示,这些工作是在 DGX-2 上运行的 Magnum IO GPU Direct Storage 技术完成的。

GPU 还可以进行全基因组测序,通过 CUDA 的帮助,华大基因的生命科学超级计算机目前已经可以实现每天 60 个基因组的吞吐量。完成这项工作的 BGI MGI-T7 超算体量并不大,只需一个节点。

英伟达推出 Parabricks 基因组分析工具包,基于 CUDA 加速,提供 DeepVariant 工具,利用深度学习进行基因组变异检测,可实现 30-50 倍的加速,用于发现变异并能产生与行业标准 GATK 最佳实践流程一致的结果。

CUDA 两个新应用,通过和爱立信的合作,CUDA 可以提高 5G RAN 的性能了。「通过实时运算,我们可以提升 5G 信号在复杂空间内的覆盖范围。」黄仁勋说道。「5G 的覆盖非常复杂,我们可以用 GPU 来解决 3D 物理空间内的信号优化问题。」

「几乎所有人都有一台 ARM 设备,很多科技巨头也在构建自己的 ARM 芯片,」黄仁勋说道。「首先它非常强大,其次人们也在构建 Hyper Scale 计算系统,而在这个过程中统一的架构效果是更好的。」英伟达今年已经开始拥抱 ARM 生态,并对相应架构提供了 CUDA 支持。

「如果说有一个在 HPC 上最重要的应用,那毫无疑问是 TensorFlow 了,」黄仁勋说道。2.0 版的 TensorFlow 现在已经获得了 ARM 架构的 CUDA 加速。

回看 2012 年,AlexNet 通过解决计算机视觉问题引发了深度学习的爆发。而在 2018 年,预训练 AI 模型 BERT 可以让计算机学习人类的只是编码,让计算机逐渐学会与人类进行自然对话,为我们阅读文章并总结其中的要点,进而更自然地与我们进行合作。

在这背后,是 GPU 提供的算力,在最近五年来,神经网络的训练速度提升了 300 倍——ResNet-50 网络的训练速度已经从 600 年降低到了仅需 2 小时。

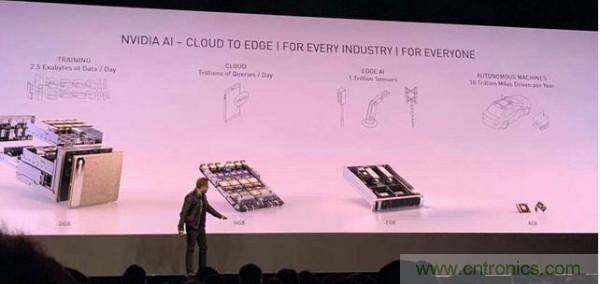

今天,英伟达的 AI 已经覆盖了各行各业,影响了很多人。自 DGX 训练的神经网络,会在 HGX 服务的云端、EGX 服务的工业终端,以及 AGX 代表的消费端设备为人们带来自动化的便利。

GPU 不仅是软件开发者训练人工智能模型的重要工具,早已在各大科技公司成为了 AI 背后的算力来源。在 GTC 上,黄仁勋介绍了两家国内科技巨头百度和阿里巴巴对英伟达最新 GPU 的应用案例。

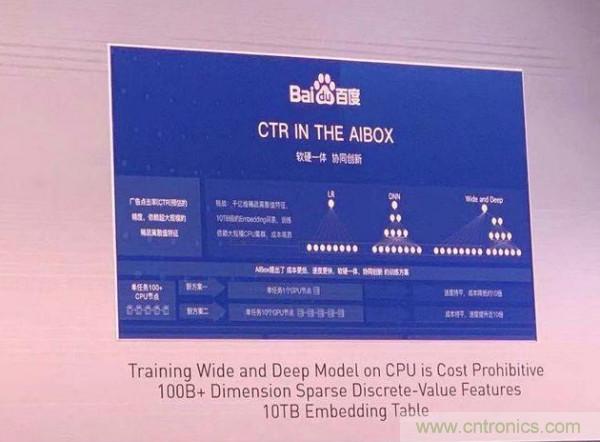

百度推荐系统将采用 英伟达 AI,其中 AIBox 推荐系统采用 Wide and Deep 结构。

百度庞大的用户潜在兴趣数据包含了千亿维稀疏离散特征和 10TB embedding 词表,100 多个推荐模型被使用在百度的众多应用中,这些模型每周都会更新,它们学习用户的潜在兴趣,新的条目和特征。「训练这些模型的 GPU 成本只有 CPU 的 1/10,并且支持更大规模的模型训练」。黄仁勋说道。

「双十一是全宇宙最神奇的节日,在这一天有 20 亿商品的销量,5 亿人次的销量,他们那天都不工作吗?」黄仁勋说道。通过英伟达 GPU 的帮助,阿里巴巴实现了每秒几十亿次的推荐请求。这个请求的数量,即使用手全球的所有 CPU 都无法实现。

TensorRT 7.0 加入 BERT 专属优化

英伟达的 TensorRT 是对 GPU 加速的高性能深度学习库,可对各种深度学习算法带来高速率、低延迟的优化,这款产品支持所有主流深度学习框架。

在 18 日的大会上,英伟达发布了 TensorRT 的最新一代 7.0 版,加入了对 BERT、RoBERTa、Tacotron 2 等大量新模型的加速支持。TRT 7 能够融合水平和垂直方向的运算,可以为开发者设计的大型 RNN 配置自动生成代码,逐点融合 LSTM 单元,甚至可以跨多个时间步长进行融合,并在这个过程中进行自动低精度推理。

总而言之,TensorRT 7 实现了 1000 多种不同的计算变换和优化。「这是一个巨大的飞跃。它可以最大程度地利用显存,提高效率,」黄仁勋说道。

最为直观的优化是什么呢?英伟达介绍了 TensorRT 7 可以带来实时的交互 AI 的体验:在支持交互是绘画 AI 上,一套端到端流程可能需要20-30种不同 AI 模型组成,其中包括很多不同的模型结构,从 CNN、RNN、transfomer、再到自编码器、MLP。通过新版的 TensorRT,我们可以对所有模型进行编译优化,在 ASR、NLU&TTS 上延迟小于 300ms,相比 CPU 速度提升 10 倍。

英伟达认为,从 AI 云到智能手机的智能化体系,今天已经触及各行各业,以及数十亿人。「现在是所有行业享受智能革命的时代了,」黄仁勋说道。

最后,在这次 GTC 上,英伟达没有对旗下 GPU 产品进行制程上的更新。对此黄仁勋向机器之心表示:「制程是很重要的,但是它不是最重要的。在最近两年里我们让 AI 的算力提升了四倍,仅仅依靠制程提升这是不可能做到的。在 GPU 的世界里,性能提升的方式和 CPU 思路不同。如 RTX 系列芯片和光线追踪技术,在 12nm 制程上达到了 AMD 7nm 制程 GPU 的性能。在加速计算的领域中,想要让芯片达到最高效率,算法、架构、软件应用需要共同合力。英伟达的架构不同于其他品牌架构。」

关于英伟达在深度学习领域最重要的产品 Tesla V100,黄仁勋表示非常满意,但没有透露其迭代或升级计划。他表示,「当你使用智能手机的过程中,一定能够和 V100 产生触点关系,无论是推荐计算还是机器人对话」。他透露,在过去一个季度里,Tesla V100 的销量超过了历史记录。

携手BAT复兴AI

首先,英伟达强调了其传统游戏领域的深耕,并宣布与腾讯游戏合作推出云游戏平台Start,该平台将使用英伟达GPU为游戏提供支持。腾讯计划推出多款云游戏,在不同平台上供玩家体验。

黄仁勋说道,AI的革新在各行各业发生,包括运输、医疗、金融、零售等行业,AI已经从云扩展到边缘,并运用于自主设备中。

他还指出,推荐系统是最重要的AI模型。100多个推荐模型被使用在百度的应用中。"阿里巴巴的'双十一'"是全宇宙最大的电商节日。"黄仁勋说道,"CPU速度太慢,只有3 QPS(每秒请求数),GPU有780 QPS。"

推荐系统正在由CPU转向GPU,这是一大趋势。

为此,英伟达宣布了与阿里巴巴和百度在AI方面的合作,百度、阿里巴巴选择英伟达的AI平台做推荐系统,用英伟达的GPU做训练。

英伟达加速计算产品管理总监Paresh Kharya对第一财经记者表示:"在阿里巴巴的服务器上,一个'双十一'活动,每秒需要处理数十亿次的推荐,使用GPU驱动的推荐系统,吞吐量(通量)可以比CPU提升上百倍。"

在GTC 2019大会上,英伟达还发布了TensorRT 7,TensorRT是一种计算图优化编译器,能优化推理实现实时AI会话。"TensorRT 7能支持1000多种不同计算变换和变化,是我们最大的飞跃。"黄仁勋表示。

会话AI功能非常复杂,原因是计算时间非常短,要在很短的时间内完成非常复杂的计算。TensorRT第一次能够完成这种复杂计算,耗时只需300毫秒,速度比CPU提升10倍,CPU需要几秒钟才能做出反应。

英伟达相信,随着会话式人工智能的兴起,对计算机推理和算法有了新的需求,因此数据中心的业务将会有显著回升。

黄仁勋还表示,快手、美团也都在使用GPU和AI推理,微软也在搜索引擎中用了英伟达的GPU平台。

下一代SOC于2022年投产

黄仁勋提到"万物智能革命"。他认为,未来AI将推广到更加广泛的应用,"从AI云到智能手机"。黄仁勋此前表示:"在边缘,GPU加速的5G、人工智能和物联网将会彻底改变世界。"

英伟达还宣布推出Nvidia Pre-trained预训练模型,能够使得汽车OEM将各自数据上传并进行优化。与此同时,公司强调了其"联邦学习"的理念,可供不同公司在不移动或不共享数据的情况下合作,并将预训练模型发送各合作伙伴。

"联邦学习"是英伟达推出的最新的加速训练的方法,通过这些方式可以帮助行业一起加速,也能确保数据隐私。

Xavier曾是英伟达打造的最先进的SOC(片上芯片系统),Nvidia Drive是英伟达软件定义的平台,运输公司能够借助该平台打造自动驾驶汽车。

英伟达在自动驾驶领域做了大会上最大的发布,下一代SoC汽车和机器人技术AGX Orin,这是一个软件定义的新一代的自动驾驶(AV)平台,是英伟达投入数十亿美元、研发多年的一款新产品,也是技术上的巨大飞跃,达到200Tops浮点,有170亿个晶体管,使用了Arm 64,比上一代的Xavier快7倍。

Orin计划于2022年进行投产。Orin是提高针对OEM的低成本版本,使得用一个单路的摄像机来做L2级别的自动驾驶成为可能,同时能利用整个AV产品线中的软件线。

英伟达还宣布和滴滴在无人驾驶方面的合作,滴滴将使用Nvidia AI技术应用,支持滴滴云。滴滴将在数据中心使用英伟达训练机器学习算法,并采用NVIDIA DRIVE为其L4级自动驾驶汽车提供推理能力。黄仁勋指出,交通产业价值100万亿美元规模。这些汽车行业的合作伙伴可以基于英伟达的系统平台进行定制和优化,同时也保护各自的数据。

与此同时,自动驾驶的技术发展正在面临瓶颈。业界认为,自动驾驶的复杂程度远超几年前所预期的。"这意味着未来自动驾驶汽车上要有更多的计算能力去跑这些软件,比如Orin和AGX产品。"英伟达汽车事业部高级总监Danny Shapiro对第一财经记者表示。

Shapiro告诉第一财经记者,自动驾驶的挑战一直在。"最开始人们的预期过于激进,认为AI超级大脑可以替代人脑来实现自动驾驶,我们确实已经做了很多训练,但还不够,需要更多训练。"他对第一财经记者说道,"我们有20多种深度网络神经模型,复杂度也在不断提升,未来数量还会增加。我们需要更精准的计算,为此我们推出了很多开发工具,现在需要让自动驾驶积累更多的里程,做大量的模拟,以确保安全。"

他还表示,下一个级别的自动驾驶是预测物体,比如其他车辆和物体,并做出反应。现在全球都在做自动驾驶的测试,但主要是在封闭环境中的自动驾驶,比如在港口、机场、矿山以及建筑工地、农田等应用场景中,以及穿梭巴士。

从云到边缘,英伟达的新重点

从AlexNet到BERT,计算机实现从图像到自然语言处理上的突破。而AI也正在从云端扩展到边缘计算端。

从云到边缘,英伟达正在为了每个场景打造一个平台,包括用于训练的DGX,用于超大规模云的HGX,用于边缘的EGX,以及用于终端的AGX。

以面向终端的AGX为例,自动驾驶和机器人是英伟达的两个重点。

· 自动驾驶:发布DRIVE AGX Orin

现场,英伟达发布了用于自动驾驶和机器人的软件定义平台——NVIDIA DRIVE AGX Orin。该平台内置全新Orin系统级芯片,Orin由170亿个晶体管组成,集成了NVIDIA新一代GPU架构和Arm Hercules CPU内核以及全新深度学习和计算机视觉加速器,每秒可运行200万亿次计算,是上一代Xavier系统级芯片性能的7倍。

Orin可处理在自动驾驶汽车和机器人中同时运行的大量应用和深度神经网络,并且达到了ISO 26262 ASIL-D等系统安全标准。

值得注意的是,Orin支持可编程,并且有丰富的工具和软件库支持,与之前的Xavier处理器兼容,支持从L2到L5级别的自动驾驶。

而且由于Orin和Xavier均可通过开放的CUDA、TensorRT API及各类库进行编程,因此开发者能够在一次性投资后使用跨多代的产品。

英伟达创始人兼首席执行官黄仁勋表示:"打造安全的自动驾驶汽车,也许是当今社会所面临的最大计算挑战。实现自动驾驶汽车所需的投入呈指数级增长,面对复杂的开发任务,像Orin这样的可扩展、可编程、软件定义的AI平台不可或缺。"

硬件之外,英伟达还发布了一套使用主动学习、联邦学习和迁移学习来训练深度神经网络的工具。以联邦学习为例,可以让多个组织和公司在不移动或共享数据的情况下进行合作,英伟达将训练模型发送给各个合作伙伴,每个合作伙伴在自己的数据上训练模型。

现场,英伟达宣布和滴滴达成合作,滴滴将使用NVIDIA GPU和其他技术开发自动驾驶和云计算解决方案。

· 机器人:发布全新Isaac SDK

今年3月的GTC会议上,英伟达就着重强调了机器人业务。今天,黄仁勋在现场发布了全新版本Isaac软件开发套件(SDK),为机器人提供更新的AI感知和仿真功能。

Isaac SDK包括Isaac Robotics Engine(提供应用程序框架),Isaac GEM(预先构建的深度神经网络模型、算法、库、驱动程序和API),用于室内物流的参考应用程序以及训练机器人Isaac Sim的第一个版本(提供导航功能)。

为了加快AI机器人的开发速度,全新Isaac SDK包括各种基于摄像头的感知深度神经网络,包括:

对象检测——识别用于导航、交互或操控的对象;

自由空间分割——检测和分割外部世界,例如确定人行道在哪里,以及机器人可以在哪里行驶;

3D姿态估计——了解目标的位置和方向,从而实现诸如机械臂拾取物体的任务;

2D人体姿态估计——将姿态估计应用于人,这对于与人互动的机器人(例如配送机器人)和协作机器人(专门设计用于与人合作)非常重要。

以新推出Isaac Sim机器人为例,它可以将所生成的软件部署到在现实世界中运行的真实机器人中。通过仿真,开发人员可以在极端情况下(即困难或异常情况下)对机器人进行测试,以进一步加强对它的训练。这有望大大加快机器人的开发速度,从而实现综合数据的训练。

另外,Isaac SDK还支持多机器人仿真。这使开发人员可以将多个机器人放入仿真环境中进行测试,以便它们学会彼此相关的工作。

发布TensorRT 7,减少会话AI推理延迟

英伟达在去年的GTC China上发布了支持自动低精度推理的TensorRT 5,今天英伟达发布了TensorRT 7,内置新型深度学习编译器,支持各种类型的RNN、CNN和Transformer,相较于TRT 5只支持30种变换,TRT 7可以支持1000多种不同的计算变换和优化。

TRT 7可为开发者设计的大量RNN配置自动生成代码,逐点融合LSTM单元,甚至可跨多个时间步长进行融合,并且尽可能做自动低精度推理。

借助TRT 7,全球各地的开发者都可以实现会话式AI应用,大幅减少推理延迟。举个例子,通常情况下,一套端到端的自然语言理解流程可能由几十种模型构成,比如RNN、CNN、自编码器等等,TRT 7可对所有模型进行编译,使其在英伟达GPU上运行。基于英伟达T4的推理会话AI只需要0.3秒,而CPU的推理延迟却高达3秒。

GPU加CUDA,从火星着陆到基因测序,无所不能

如今,英伟达已经售出了15亿块GPU,在使用的每块GPU都兼容CUDA。英伟达的CUDA平台具有丰富的库、工具和应用程序。仅在去年,英伟达发布了500多个SDK和库,通过优化软件栈,英伟达提高了GPU的性能,让深度学习训练在三年内提高了4倍,深度学习推理在一年内提高了2倍。

HPC应用方面,NASA在英伟达GPU上通过FUN3D软件运行火星着陆情景模拟,产生高达150TB的数据,英伟达借助DGX-2上运行的Magnum IO GPU Direct Storage技术,可"实时"对这些数据进行可视化处理。

另外,由于GPU的训练成本只有传统CPU的十分之一,并且可支持更大规模的模型训练,英伟达发布了深度推荐系统,百度以及阿里均有采用。

CUDA方面,英伟达发布了由CUDA加速的Parabricks基因组分析工具包,可实现30到50倍的加速,目前华大基因已经采用Parabricks来进行基因变异检测,除此之外,CUDA新增加了对5G vRAN应用的支持。

和腾讯合作,推出云游戏服务

在游戏方面,微软出品的游戏《我的世界》支持RTX,可以实时完成预烘焙全局光线和一般反射的灯光效果。同时,黄仁勋还宣布了其他6款GeForce RTX 游戏。

随着谷歌、微软入局云游戏,英伟达也将眼光投向了云游戏,现场英伟达宣布与腾讯合作推出START云游戏服务,由英伟达提供GPU支持。

硬件方面,英伟达为PC笔记本提供的Max-Q设计,可将高性能GPU集成到轻薄笔记本中,数据显示,今年,GeForce RTX MAX 笔记本电脑是增长速度最快的游戏平台。

3D内容创作上,黄仁勋介绍了英伟达的OMNIVERSE的进展,发布面向建筑行业(AEC)的OMNIVERSE,在工作流中增加实时协作功能。

去年,在 GTC China大会上,英伟达发布了 TensorRT5,支持自动低精度推理,将FP32模型转换成FP16或者INT8模型,而不损失准确率。

黄仁勋说到,TensorRT5存在着一个不足之处,那就是它仅支持CNN。而大多数语音模型需要RNN的支持,语音推理需要大量的工作负载,为此,今年我们推出了TensorRT7。

可以这么说,TRT7是英伟达实现的最大飞跃。

推荐阅读: